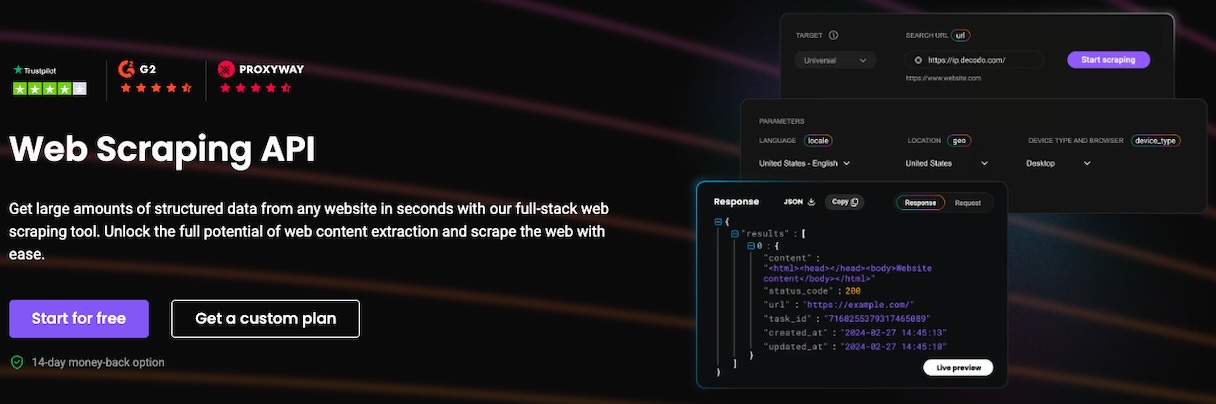

Falls Sie Decodo (ehemals bekannt als Smartproxy) für Proxy-Dienste nutzen, sollten Sie dieser Ankündigung Aufmerksamkeit schenken. Das Unternehmen hat gerade eine vollständig überarbeitete Web Scraping API veröffentlicht, die grundlegend verändert, wie Sie für Scraping bezahlen. Anstatt Sie auf Fixpläne festzulegen, bei denen jede Anfrage unabhängig davon die gleiche Ressourcenmenge erhält, ob sie diese benötigt oder nicht, ermöglicht die neue API Ihnen, die Scraping-Komplexität auf Anfragebasis zu kontrollieren.

Dies ist ein erheblicher Abweichung davon, wie die meisten Scraping-APIs auf dem Markt heute bepreist werden, und es lohnt sich zu verstehen, was sich geändert hat und warum es für Ihre Scraping-Workflows wichtig ist.

Was sich geändert hat: Von Fixplänen zu modularer, anfragebezogener Preisgestaltung

Unter dem alten Modell funktionierten Decodos Scraping-Pläne wie bei den meisten Konkurrenten: Sie wählten eine Abonnement-Stufe aus, die eine festgelegte Anfragemenge mit einem festen Funktionsumfang bündelte. Benötigen Sie JavaScript-Rendering für ein schwieriges Ziel? Sie mussten Ihren gesamten Plan upgraden. Möchten Sie Premium-Proxys für eine einzelne stark geschützte Website? Gleiches Ergebnis – erzwungene Upgrades über die gesamte Palette.

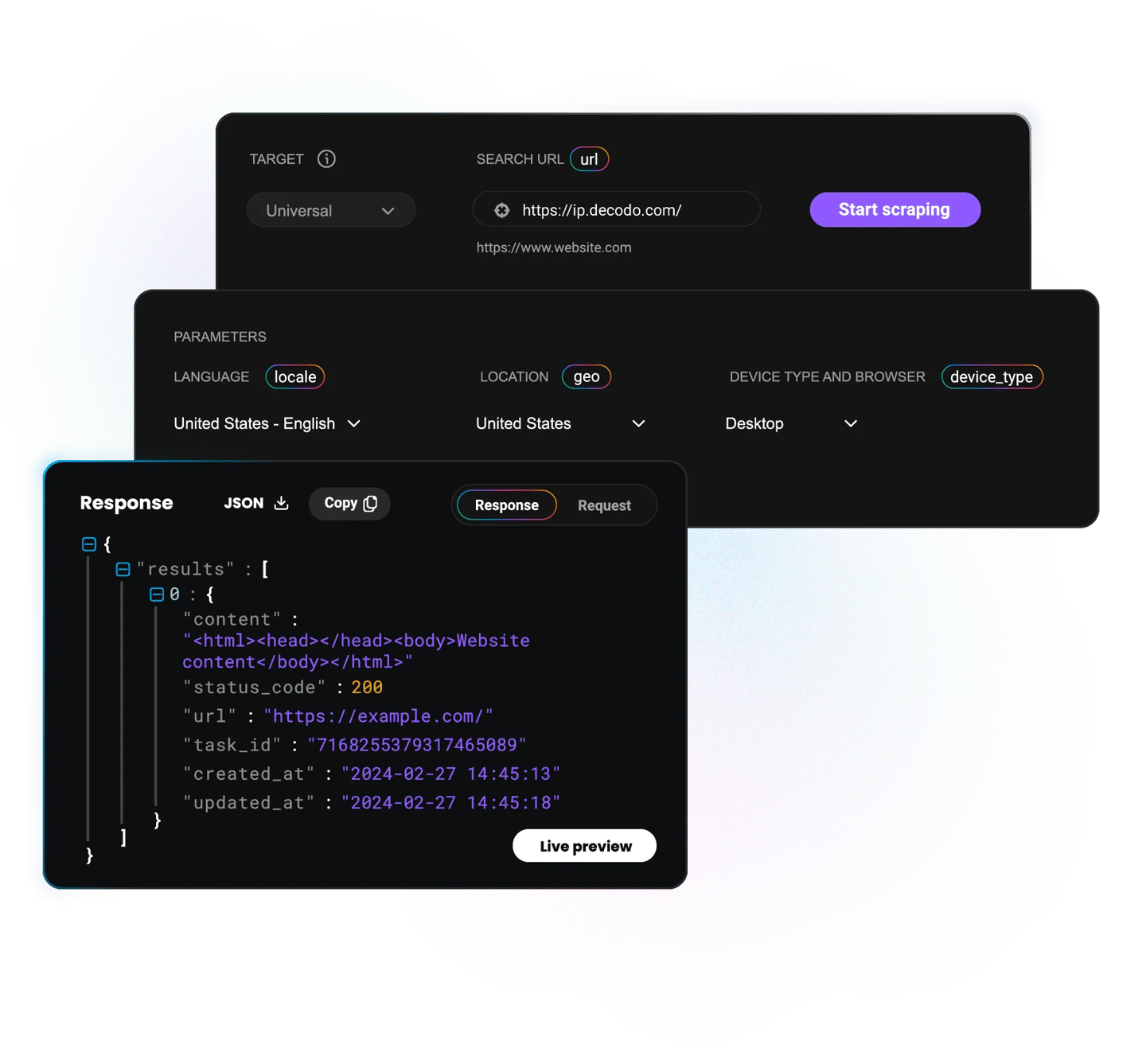

Das neue Modell dreht dies um. Nun kann jede einzelne API-Anfrage, die Sie erstellen, individuell mit genau der Leistung konfiguriert werden, die sie benötigt. Es gibt zwei Haupt-Schalter, die Sie pro Anfrage kontrollieren:

Proxy-Pool-Auswahl — Wählen Sie zwischen Standard-Proxys (optimiert für einfache, statische Seiten mit niedriger bis mittlerer Sicherheit) oder Premium-Proxys (konstruiert für fortgeschrittene Bot-Schutz, CAPTCHAs und stark geschützte Seiten).

JavaScript-Rendering — Aktivieren oder deaktivieren Sie JS-Rendering pro Anfrage. Statische HTML-Seiten, die keine Client-seitiges Rendering benötigen, können ohne dieses verarbeitet werden, was die Kosten niedrig hält. Dynamische Seiten, die Inhalte über JavaScript laden, können Rendering nur bei Bedarf aktiviert haben.

Das Ergebnis sind vier mögliche Anfrage-Typen, jeder mit seinen eigenen Kosten pro 1.000 erfolgreiche Anfragen: Nur Standard-Proxys (am günstigsten), Standard + JS-Rendering, nur Premium-Proxys und Premium + JS-Rendering (am teuersten). Ihre monatliche Rechnung spiegelt genau wider, welche Ressourcen jede Anfrage tatsächlich verbraucht hat – nichts mehr.

Preisübersicht: Was kostet es tatsächlich?

Decodo bietet mehrere Stufen an, jede mit progressiv besseren Pro-Anfrage-Raten. So sieht die Preisgestaltung für alle vier Anfrage-Typen aus:

| Plan | Monatlicher Preis | Standard (pro 1K) | Standard + JS (pro 1K) | Premium (pro 1K) | Premium + JS (pro 1K) | Ratenlimit |

|---|---|---|---|---|---|---|

| Kostenlos | $0 | $0.50 | $0.75 | $1.00 | $1.50 | 10 req/s |

| Starter | $19/mo | $0.50 | $0.75 | $1.00 | $1.50 | 10 req/s |

| Professional | $49/mo | $0.30 | $0.65 | $0.90 | $1.25 | 25 req/s |

| Business | $99/mo | $0.14 | $0.60 | $0.85 | $1.20 | 50 req/s |

| Enterprise | Benutzerdefiniert | Benutzerdefiniert | Benutzerdefiniert | Benutzerdefiniert | Benutzerdefiniert | Bis zu 200 req/s |

Die Zahlen erzählen eine interessante Geschichte. Wenn die meisten Ihrer Scraping-Ziele einfache statische Seiten sind, könnten Sie für nur $0,14 pro 1.000 Anfragen im Business-Plan zahlen. Das ist äußerst wettbewerbsfähig. Die Kosten steigen nur, wenn Sie tatsächlich die schwere Arbeit benötigen – JS-Rendering oder Premium-Proxy-Pools für Bot-geschützte Ziele.

Vergleichen Sie dies mit einem traditionellen Fixplan-Modell, bei dem Sie möglicherweise unabhängig von der Zielkomplexität einen einheitlichen $1,00+ pro 1.000 Anfragen zahlen. Für gemischte Workloads (was die meisten echten Scraping-Pipelines sind), können die Einsparungen erheblich sein.

Warum dies für Web Scraper wichtig ist

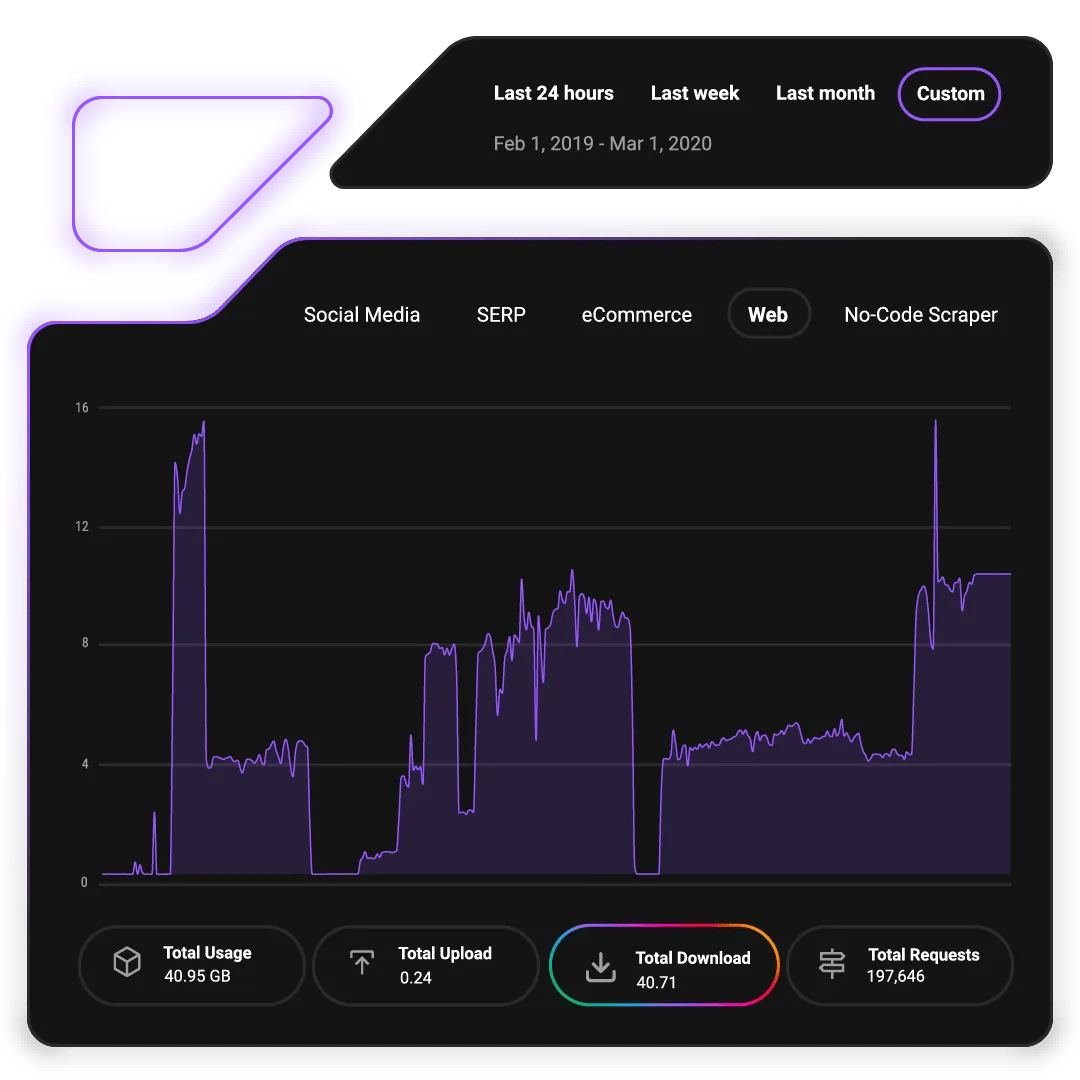

Die meisten Scraping-Operationen treffen nicht immer wieder auf denselben Zieltyp. Eine typische Pipeline könnte so aussehen: 60% einfache statische HTML-Seiten (Produktlisten, öffentliche Verzeichnisse, Nachrichtenartikel), 25% Seiten, die JavaScript-Rendering benötigen (SPAs, lazy-geladene Inhalte, dynamisch gerenderte Preise) und 15% stark geschützte Seiten, die Premium-Proxys und vollständige Browser-Emulation benötigen (große E-Commerce-Plattformen, soziale Medien, Reisebuchungsseiten).

Unter einem traditionellen Fixplan-Modell zahlen Sie letztendlich den Höchsttarif für alle diese Anfragen, da der Plan Ihre schwierigsten Ziele unterstützen muss. Unter Decodos neuem Modell laufen 60% Ihrer Anfragen zum günstigsten Tarif, 25% zu einem mittleren Tarif und nur 15% treffen die höchste Preisgestaltung. Der Gesamtkostenunterschied für eine gemischte Workload kann dramatisch sein.

Wichtigste Funktionen über die Preisgestaltung hinaus

Das modulare Preismodell ist die Schlagzeile, aber die zugrunde liegende API ist vollgepackt mit Funktionen, die sie wirklich nützlich für Production Scraping macht:

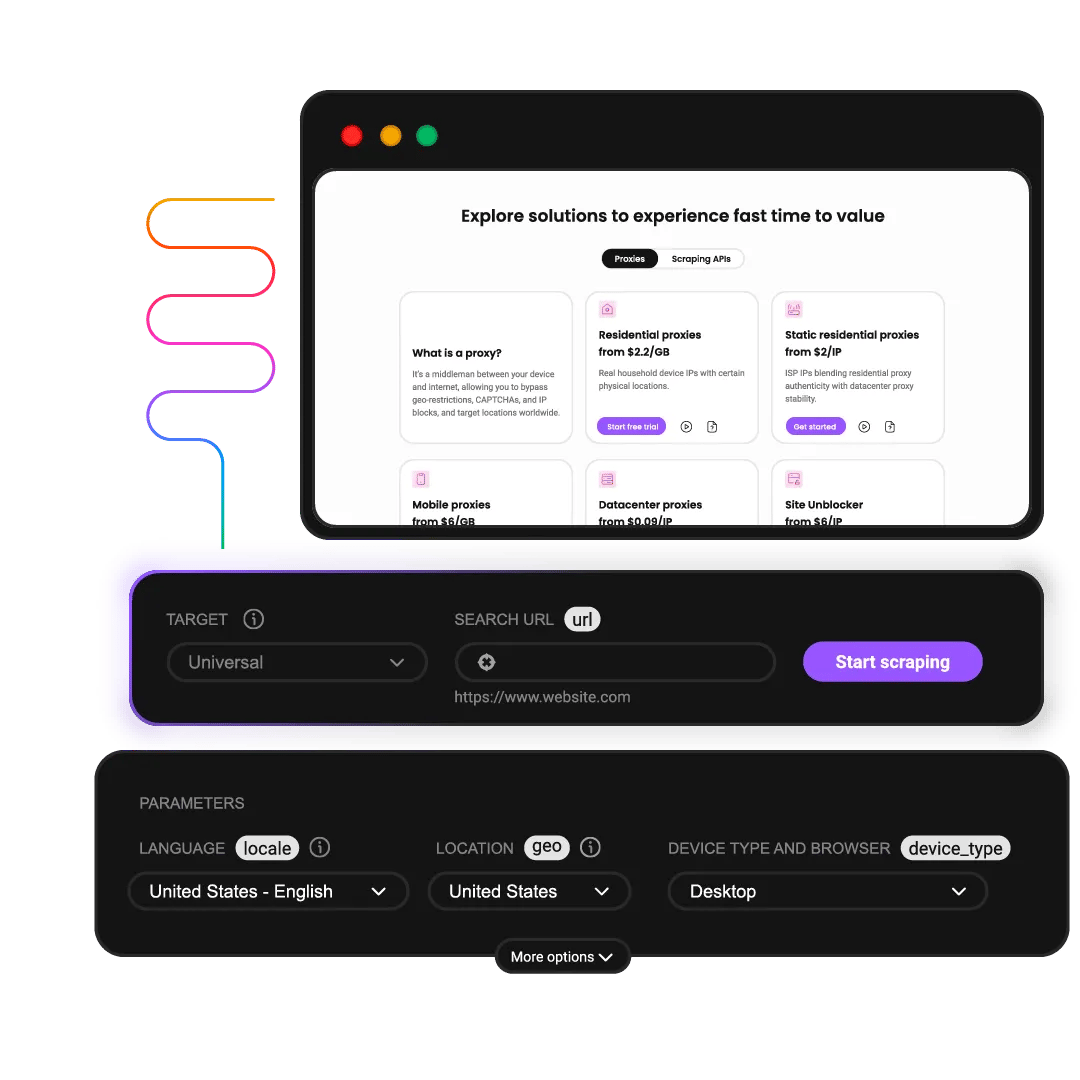

100+ vorgefertigte Vorlagen — Decodo bietet vorgefertigte, anpassbare Scraper-Vorlagen für populäre Ziele einschließlich Google Search, Amazon, YouTube, Walmart, Bing und vielen mehr. Diese Vorlagen behandeln zielspezifische Bot-Schutzmaßnahmen und Parsing-Logik aus der Box, sodass Sie nicht jede Seite selbst reverse-engineeren müssen.

Mehrere Ausgabeformate — Erhalten Sie Ihre gescrapten Daten als rohes HTML, strukturiertes JSON, CSV oder sogar PNG-Screenshots zurück. Es gibt auch ein LLM-bereites Markdown-Ausgabeformat, das zunehmend nützlich ist, wenn Sie gescrapte Daten in AI-Pipelines speisen.

Massive Proxy-Infrastruktur — Hinter der API steht Decodos Proxy-Netzwerk mit über 125 Millionen IPs, einschließlich 115M+ ethisch beschaffte Residenz-IPs, 10M+ Mobile IPs über 700+ ASN-Träger und 500K+ Rechenzentrum-IPs. Die geografische Ausrichtung geht bis zur Stadt- und Postleitzahl-Ebene über 195+ Standorte.

200 Anfragen pro Sekunde Durchsatz — Bei Enterprise-Plänen kann die API bis zu 200 gleichzeitige Anfragen pro Sekunde verarbeiten. Selbst der kostenlose Tarif ermöglicht 10 req/s, was für Tests und kleine Projekte ausreicht.

99,99% Erfolgsquote — Decodo beansprucht eine nahezu perfekte Erfolgsquote über Scraping-Operationen, unterstützt durch automatische Wiederholungslogik und intelligente Proxy-Rotation.

Sync- und Async-Modi — Führen Sie Anfragen in Echtzeit für sofortige Ergebnisse aus, oder verwenden Sie den asynchronen Modus mit Callback-Integration für große Batch-Jobs. Aufgabenplanung mit E-Mail-Benachrichtigungen ist auch für wiederkehrende Scraping-Aufgaben verfügbar.

Für wen ist dies am besten?

Das neue modulare Preismodell glänzt am hellsten in einigen spezifischen Szenarien:

Preisüberwachung und E-Commerce-Verfolgung — Wenn Sie Produktseiten über Dutzende Einzelhandelsketten scrapen, werden einige einfaches HTML sein, während andere (wie Amazon oder Walmart) JS-Rendering und Premium-Proxys benötigen. Das Zahlen pro Komplexität anstelle pro Plan bedeutet, dass Ihre einfachen Ziele Ihre schwierigen nicht subventionieren.

Marktintelligenz und Forschung — Das Scrapen einer großen Vielfalt von Quellen (Nachrichten, Regierungsdaten, Unternehmenswebsites, soziale Medien) bedeutet ständige Variation in der Zielschwiereheit. Das modulare Modell passt sich natürlich an.

Agentur- und Multi-Client-Pipelines — Wenn Sie Scraping-Infrastruktur für mehrere Clients mit verschiedenen Zielprofilen betreiben, müssen Sie nicht mehr separate Pläne pflegen oder Über-Provisioning für Worst-Case-Szenarien durchführen.

SEO- und SERP-Überwachung — Google und Bing Scraping ist gut durch Decodos Vorlagen abgedeckt, und Suchergebnisseiten sind normalerweise unkompliziert genug zum Scrapen ohne Premium-Proxys, was die Kosten niedrig hält.

Erste Schritte: Kostenloser Tarif verfügbar

Eines der angenehmen Dinge ist, dass Decodo einen wirklich nutzbaren kostenlosen Tarif anbietet: $0/Monat mit ausreichend Credits für etwa 2.000 Standard-Anfragen oder 667 Premium + JS Anfragen. Es gibt auch einen API Playground mit 10 Test-Anfragen pro Tag, sodass Sie den Service bewerten können, bevor Sie Geld festlegen. Alle bezahlten Pläne enthalten eine 14-tägige Geld-zurück-Garantie.

Die API unterstützt Python, PHP und Node.js mit Code-Beispielen und Postman-Sammlungen, die in ihrer Dokumentation verfügbar sind. Das Setup ist unkompliziert – Sie erhalten einen API-Schlüssel, konfigurieren Ihre Anfrageparameter (Ziel-URL, Proxy-Typ, JS-Rendering-Schalter, Ausgabeformat) und senden Anfragen über einen einzelnen Endpunkt.

Unser Eindruck

Der Proxy- und Scraping-API-Markt bewegt sich schon seit einiger Zeit zu flexiblerer Preisgestaltung, aber Decodos Implementierung ist eine der granularsten, die wir gesehen haben. Der Pro-Anfrage-Komplexitäts-Schalter ist nicht nur ein Marketing-Winkel – er verändert wirklich die Wirtschaft des Betriebs gemischter Scraping-Workloads.

Wenn Sie derzeit bei einem Scraping-Service mit Fixplan sind und Ihre Ziele in der Schwierigkeit variieren (was, ehrlich gesagt, sicherlich der Fall ist), lohnt es sich, die Zahlen für Ihre tatsächlichen Kosten unter Decodos Modell durchzurechnen. Für Pipelines, die auf einfaches HTML-Scraping mit gelegentlicher Notwendigkeit für JS-Rendering oder Premium-Proxys ausgelegt sind, könnten die Einsparungen erheblich sein.

Der 125M+ IP-Pool, 99,99% Erfolgsquote und 100+ vorgefertigte Vorlagen sind starke Grundlagen. Kombiniert mit dem neuen Preismodell positioniert sich Decodos Scraping-API als ernsthafter Konkurrent für jeden, der im Jahr 2026 Production Scraping im großen Maßstab durchführt.

Sie können die neue API kostenlos unter decodo.com ausprobieren — keine Kreditkarte erforderlich für den kostenlosen Tarif.