Als je Decodo (voorheen bekend als Smartproxy) voor proxyservices hebt gebruikt, wil je hiervan op de hoogte zijn. Het bedrijf heeft zojuist een volledig opnieuw ontworpen Web Scraping API gelanceerd die fundamenteel verandert hoe je voor scraping betaalt. In plaats van je in vaste-niveauplannen vast te zetten waarbij elke aanvraag dezelfde hoeveelheid resources krijgt, ongeacht wat deze nodig heeft, laat de nieuwe API je de scraping-complexiteit per aanvraag controleren.

Dit is een significant vertrek van hoe de meeste scraping API's tegenwoordig op de markt worden geprijsd, en het is de moeite waard om te begrijpen wat er is veranderd en waarom het voor jouw scraping-workflows van belang is.

Wat is er Veranderd: Van Vaste Plannen naar Modulaire, Per-Verzoek Prijsstelling

In het oude model werkten Decodo's scraping-plannen als die van de meeste concurrenten: je koos een abonnementslaag die een vaste hoeveelheid aanvragen bundelde met een vast functiepakket. Heb je JavaScript-rendering nodig voor één lastig doel? Je moest je hele plan upgraden. Wil je premium proxies voor een enkele sterk beveiligde site? Hetzelfde verhaal — gedwongen upgrades overal.

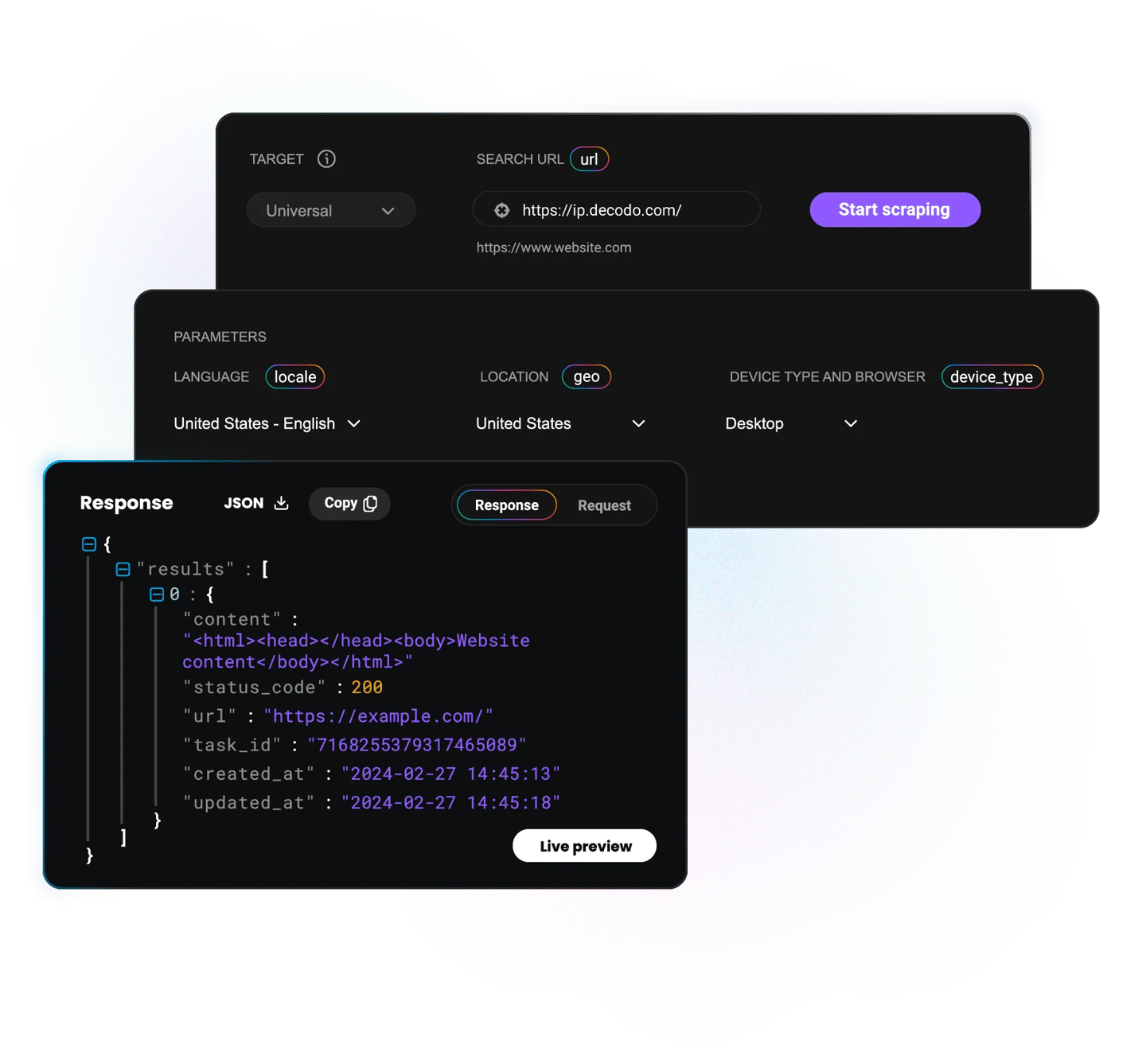

Het nieuwe model draait dit om. Nu kan elke API-aanvraag die je doet individueel worden geconfigureerd met precies het vermogensniveau dat het nodig heeft. Er zijn twee hoofdschakelaars die je per aanvraag controleert:

Selectie van Proxy Pool — Kies tussen Standard proxies (geoptimaliseerd voor eenvoudige, statische pagina's met lage tot gematigde beveiliging) of Premium proxies (gebouwd om geavanceerde anti-bot-protecties, CAPTCHA's en sterk beveiligde sites aan te pakken).

JavaScript Rendering — Schakel JS-rendering per aanvraag in of uit. Statische HTML-pagina's die niet afhankelijk zijn van rendering aan de clientzijde kunnen zonder rendering worden gescraped, waardoor de kosten laag blijven. Dynamische sites die inhoud laden via JavaScript kunnen het rendering alleen ingeschakeld krijgen wanneer dit nodig is.

Het resultaat is vier mogelijke aanvraagtypen, elk met zijn eigen kosten per 1.000 succesvolle aanvragen: Alleen Standard proxies (goedkoopste), Standard + JS rendering, Alleen Premium proxies en Premium + JS rendering (duurste). Je maandelijkse rekening weerspiegelt precies welke resources elke aanvraag werkelijk heeft verbruikt — niets meer.

Prijsoverzicht: Wat Kost het Eigenlijk?

Decodo biedt verschillende categorieën aan, elk met progressief betere per-aanvraag-tarieven. Hier is hoe de prijsstelling zich uitbreidt over alle vier aanvraagtypen:

| Plan | Maandelijkse Prijs | Standard (per 1K) | Standard + JS (per 1K) | Premium (per 1K) | Premium + JS (per 1K) | Snelheidslimiet |

|---|---|---|---|---|---|---|

| Gratis | $0 | $0.50 | $0.75 | $1.00 | $1.50 | 10 req/s |

| Starter | $19/ma | $0.50 | $0.75 | $1.00 | $1.50 | 10 req/s |

| Professional | $49/ma | $0.30 | $0.65 | $0.90 | $1.25 | 25 req/s |

| Business | $99/ma | $0.14 | $0.60 | $0.85 | $1.20 | 50 req/s |

| Enterprise | Aangepast | Aangepast | Aangepast | Aangepast | Aangepast | Tot 200 req/s |

De getallen vertellen een interessant verhaal. Als de meeste van je scraping-doelen eenvoudige statische pagina's zijn, kun je mogelijk slechts $0,14 per 1.000 aanvragen betalen in het Business-plan. Dat is uiterst competitief. De kosten stijgen alleen wanneer je werkelijk zware taken nodig hebt — JS rendering of premium proxy-pools voor anti-bot-beveiligde doelen.

Vergelijk dit met een traditioneel vast planmodel waarbij je misschien $1,00+ per 1.000 aanvragen betaalt, ongeacht de complexiteit van het doel. Voor gemengde werkbelastingen (wat de meeste echte scraping-pipelines zijn), kunnen de besparingen aanzienlijk zijn.

Waarom Dit Belangrijk is voor Web Scrapers

De meeste scraping-operaties richten zich niet herhaaldelijk op hetzelfde type doel. Een typische pipeline ziet er als volgt uit: 60% eenvoudige statische HTML-pagina's (productlijsten, openbare mappen, nieuwsartikelen), 25% pagina's die JavaScript-rendering vereisen (SPA's, lazy-loaded inhoud, dynamisch gerenderde prijzen), en 15% sterk beveiligde sites die premium proxies en volledig browseremulatie nodig hebben (grote e-commerce platforms, sociale media, reisboekingssites).

Met een traditioneel vast planmodel betaal je uiteindelijk de hoogste-laag prijs voor al deze aanvragen omdat het plan je moeilijkste doelen moet accommoderen. Met Decodo's nieuwe model draait 60% van je aanvragen op het goedkoopste tarief, 25% op een midden-laag tarief, en slechts 15% bereikt de topprijs. Het totale kostenverschil voor een gemengde werkbelasting kan dramatisch zijn.

Belangrijkste Functies Naast Prijsstelling

Het modulaire prijsmodel is het hoofdpunt, maar de onderliggende API zit vol met functies die het werkelijk nuttig maken voor productie-scraping:

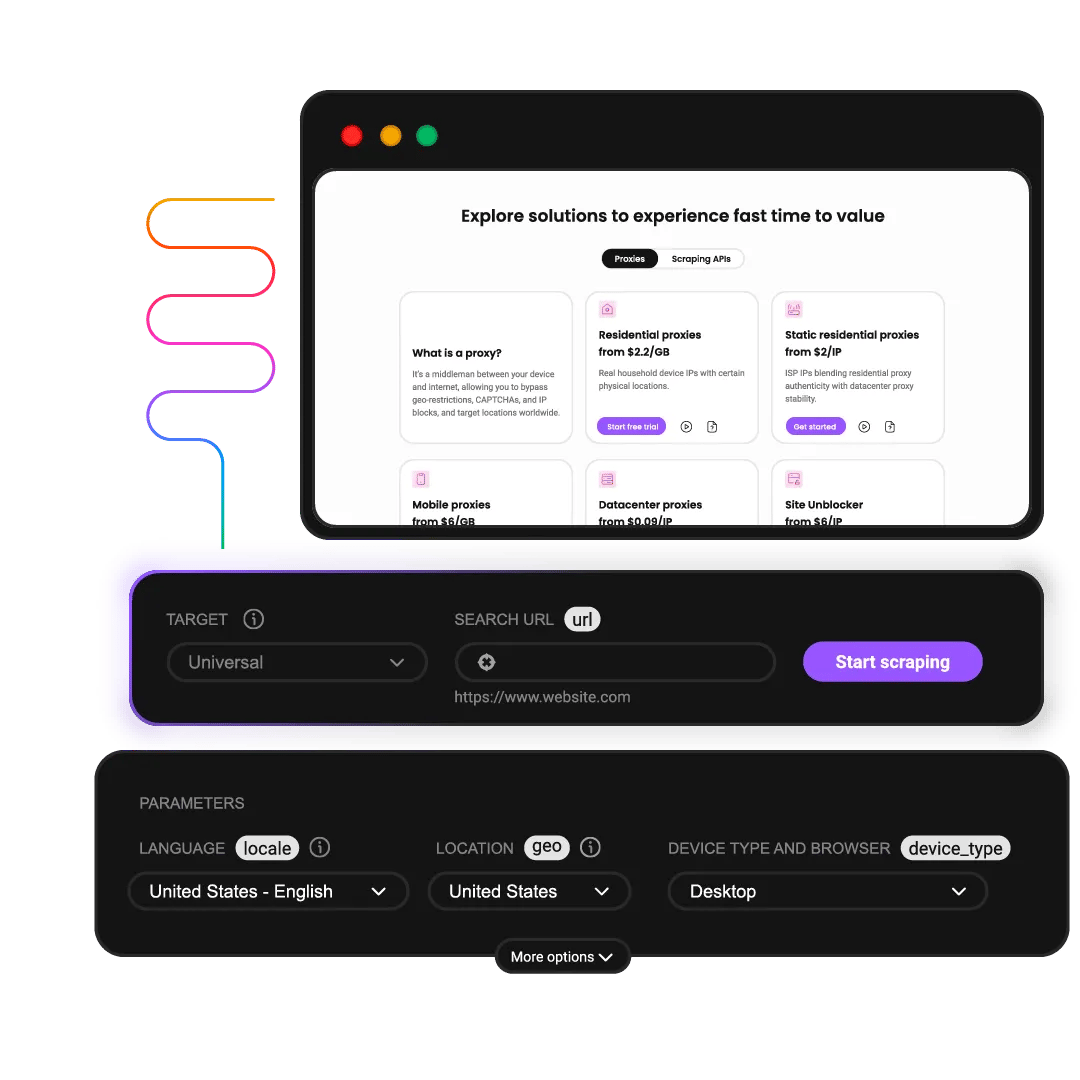

100+ Voorbereide Sjablonen — Decodo biedt voorgebouwde, aanpasbare scraper-sjablonen voor populaire doelen, waaronder Google Search, Amazon, YouTube, Walmart, Bing en nog veel meer. Deze sjablonen behandelen doelspecifieke anti-bot-maatregelen en parse-logica direct uit de doos, dus je hoeft elke site niet zelf reverse-engineer.

Meerdere Uitvoerformaten — Krijg je gescrapte gegevens terug als onbewerkt HTML, gestructureerde JSON, CSV of zelfs PNG-schermafbeeldingen. Er is ook een LLM-gereed markdown-uitvoerformaat, wat steeds nuttiger is als je gescrapte gegevens in AI-pipelines voert.

Enorme Proxy-infrastructuur — Achter de API ligt Decodo's proxynetwerk van meer dan 125 miljoen IP's, inclusief 115M+ ethisch verkregen residentiële IP's, 10M+ mobiele IP's over 700+ ASN-dragers, en 500K+ datacenter-IP's. Geografische targeting gaat tot stad- en postcodeniveau in meer dan 195 locaties.

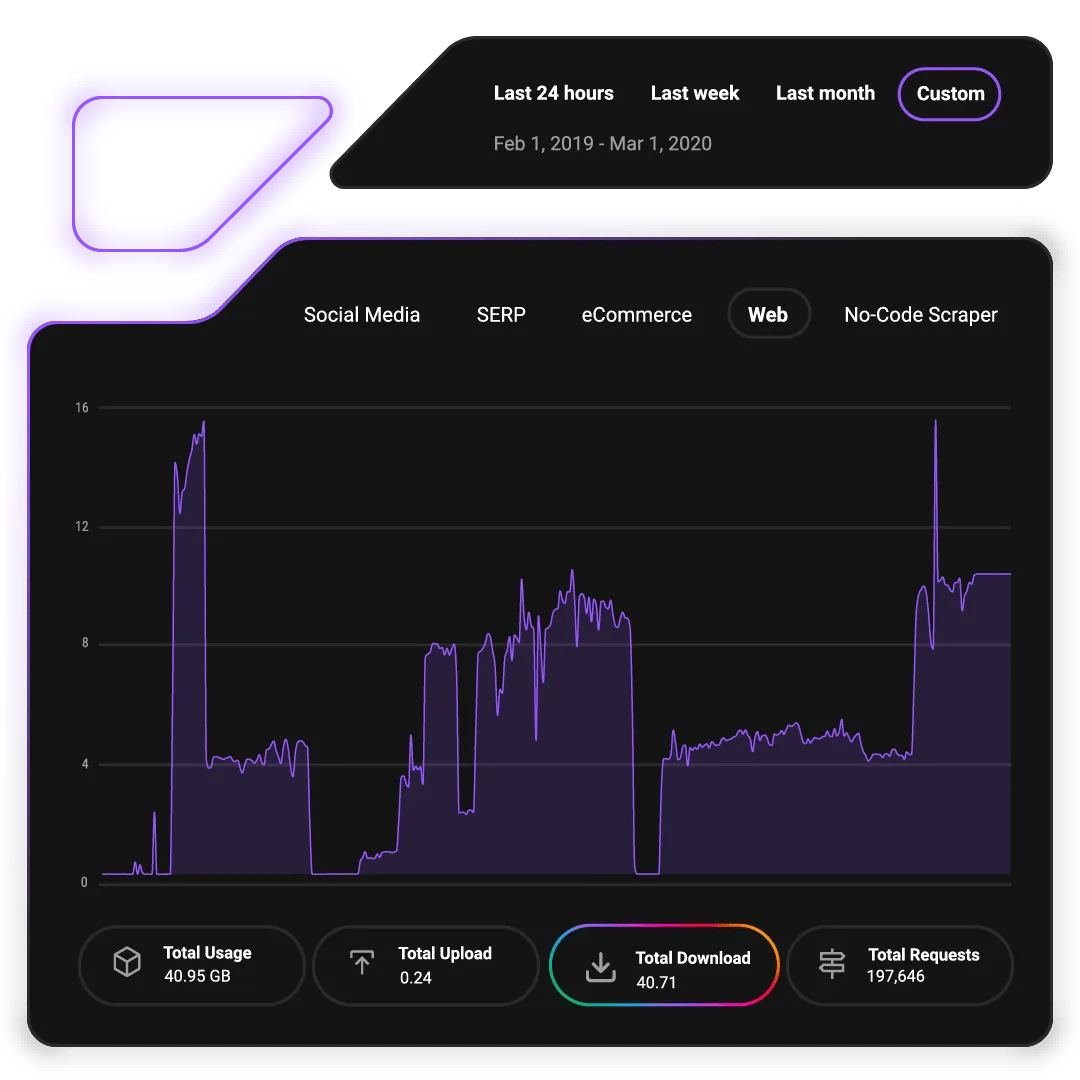

200 Aanvragen per Seconde Doorvoer — Bij enterprise-plannen kan de API tot 200 gelijktijdige aanvragen per seconde verwerken. Zelfs de gratis laag staat 10 req/s toe, wat voldoende is voor testen en kleine projecten.

99,99% Succespercentage — Decodo stelt een bijna perfecte succespercentage voor zijn scraping-operaties, ondersteund door automatische retry-logica en intelligente proxy-rotatie.

Synchrone en Asynchrone Modi — Voer aanvragen in real-time uit voor onmiddellijke resultaten, of gebruik asynchrone modus met callback-integratie voor grote batchklussen. Taakplanning met e-mailmeldingen is ook beschikbaar voor terugkerende scraping-taken.

Voor Wie is Dit het Beste?

Het nieuwe modulaire prijsmodel schijnt het helderst in enkele specifieke scenario's:

Prijsbewaking en e-commerce tracking — Als je productpagina's over tientallen retailers scrapet, zullen sommige eenvoudig HTML zijn terwijl andere (zoals Amazon of Walmart) JS-rendering en premium proxies vereisen. Betalen per-complexiteit in plaats van per-plan betekent dat je eenvoudige doelen je moeilijke doelen niet subsidiëren.

Marktintelligentie en onderzoek — Het scrapen van een groot aantal bronnen (nieuws, overheidsgegevens, bedrijfswebsites, sociale media) betekent constante variatie in doelmoeilijkheid. Het modulaire model past zich natuurlijk aan.

Agency- en multi-client-pipelines — Als je scraping-infrastructuur voor meerdere clients met verschillende doelprofielen uitvoert, hoef je niet langer afzonderlijke plannen te onderhouden of voor worst-case-scenario's te veel in te richten.

SEO- en SERP-bewaking — Google- en Bing-scraping wordt goed afgedekt door Decodo's sjablonen, en zoekresultatenpagina's zijn meestal eenvoudig genoeg om zonder premium proxies te scrapen, waardoor de kosten laag blijven.

Aan de Slag: Gratis Laag Beschikbaar

Een van de mooie dingen is dat Decodo een werkelijk bruikbare gratis laag biedt: $0/maand met genoeg tegoed voor ongeveer 2.000 standaard aanvragen of 667 premium+JS aanvragen. Er is ook een API Playground met 10 testaanvragen per dag, zodat je de service kunt evalueren voordat je geld commit. Alle betaalde plannen bevatten een garantie van 14 dagen geld terug.

De API ondersteunt Python, PHP en Node.js met codevoorbeelden en Postman-collecties beschikbaar in hun documentatie. Het instellen is eenvoudig — je krijgt een API-sleutel, configureert je aanvraagparameters (doel-URL, proxy-type, JS-rendering-schakelaar, uitvoerformaat), en verzendt aanvragen via één endpoint.

Onze Mening

De proxy- en scraping-API-markt is een tijdje in de richting van meer flexibele prijzen gegaan, maar Decodo's implementatie is een van de granulairste die we hebben gezien. De per-aanvraag-complexiteitschakelaar is niet zomaar een marketinghoek — het verandert werkelijk de economie van het uitvoeren van gemengde scraping-werkbelastingen.

Als je momenteel een vaste-plan scraping-service gebruikt en je doelen variëren in moeilijkheid (wat, laten we eerlijk zijn, vrijwel zeker het geval is), loont het zich om de getallen door te rekenen voor wat je werkelijke kosten onder Decodo's model zouden zijn. Voor pipelines die zwaar zijn in eenvoudig HTML-scraping met af en toe behoefte aan JS-rendering of premium proxies, kunnen de besparingen aanzienlijk zijn.

De 125M+ IP-pool, 99,99% succespercentage en 100+ voorbereide sjablonen zijn sterke fundamenten. Gecombineerd met het nieuwe prijsmodel, positioneert Decodo's Scraping API zichzelf als een serieuze kanshebber voor iedereen die in 2026 op schaal productie-scraping uitvoert.

Je kunt de nieuwe API gratis proberen op decodo.com — geen creditcard vereist voor de gratis laag.